美聯社電

學校正面臨日益嚴重的問題:學生利用人工智能(AI)將無辜同學的照片轉化為深度偽造的露骨內容。這些經竄改的照片與視頻散播後造成的惡果,讓受害者陷入噩夢。

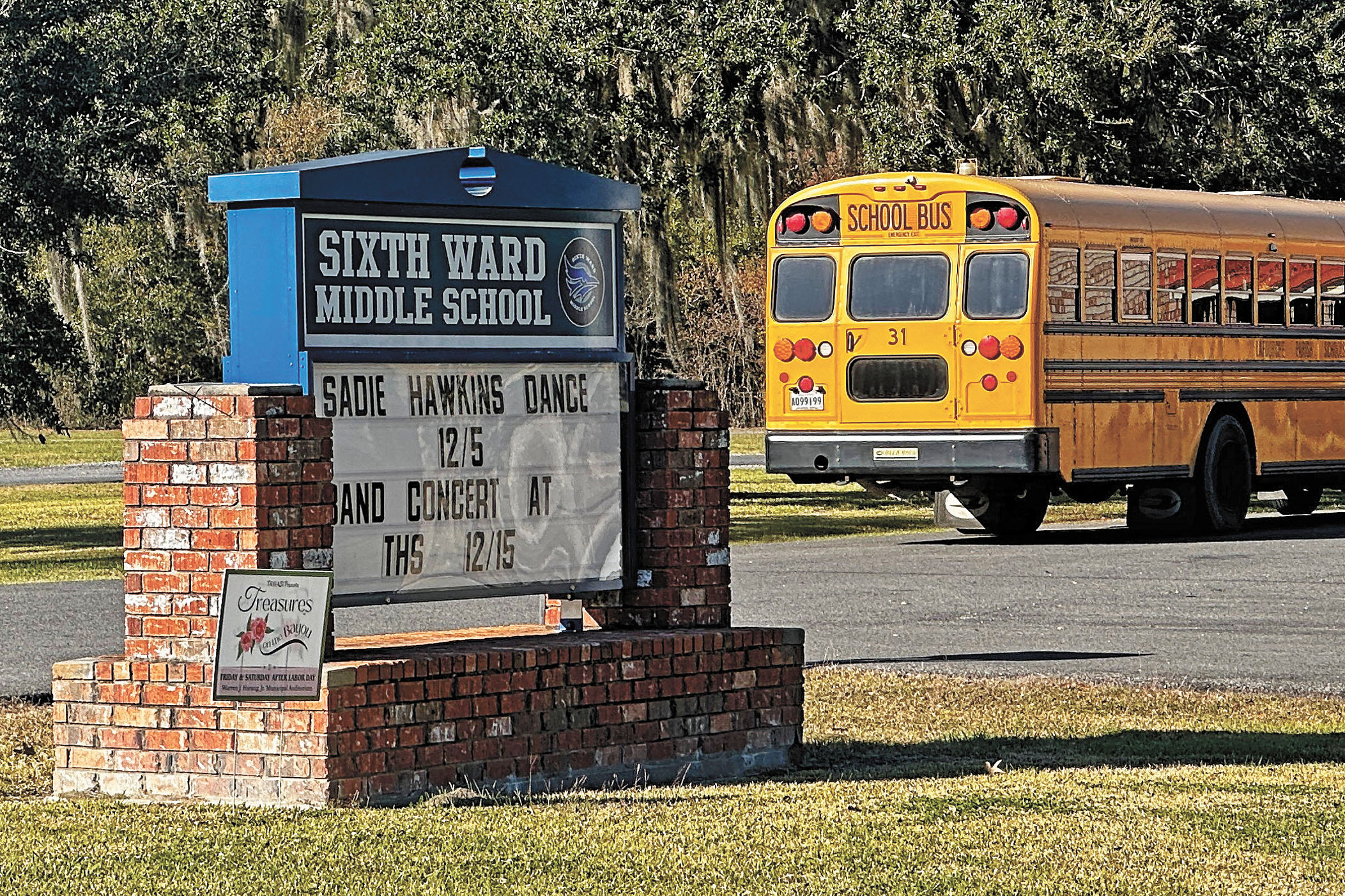

2025年秋季,路易斯安那州一所初中爆發AI生成裸照事件,凸顯出學校面臨的挑戰。兩名男生最終遭起訴,但在此之前,已有一名受害女生因與她指控製作照片的男生發生衝突而遭開除。

當地教區警局局長韋布雷(Craig Webre)指出:「雖然幾十年前就有篡改影像的技術,但AI的興起讓任何人幾乎無需訓練就能輕易製造此類影像。這一事件凸顯出的嚴重隱憂,所有家長都應與子女共同面對。」

多個州立法應對深偽技術

路易斯安那州初中的深度偽造案,是該州新法實施後的首宗相關起訴。全國州議會大會數據顯示,2025年,至少有半數的州份已頒布法規,規範利用生成式AI製造深偽圖像與聲音。一些法律更針對性地打擊模擬兒童性虐待的素材。

佛羅里達州與賓州已有學生被起訴,加州等地出現了學生遭開除的案例。德州一名五年級教師更因涉嫌利用AI製造關於他學生的兒童色情內容而遭起訴。

深偽技術最初被用來羞辱政敵和年輕女星。德州基督教大學研究員亞歷山大(Sergio Alexander)指出,幾年之前,製作逼真偽造內容仍需專業技術,「如今在社交媒體下載個應用程式,無需任何技術背景就可完成」。

問題的規模之大令人震驚。美國失蹤與受虐兒童中心指出,向其網路專線舉報的AI生成兒童性虐影像數量激增,2023年全年4700件,到2025年僅上半年就達44萬件。

AI深偽造成的創傷尤為嚴重

「網絡霸凌研究中心」聯合主任辛杜賈(Sameer Hinduja)建議學校更新針對AI生成深偽內容的政策,並加強相關解釋工作,這樣「學生就不會認為教職員完全不知情,進而有恃無恐。」

他指出許多家長誤以為學校已著手處理問題,實則不然。

「太多人對此毫無認知且無知至極」,身兼佛羅里達大西洋大學犯罪學與司法公正學院教授的辛杜賈說,「我們常聽聞鴕鳥綜合症——他們將頭埋進沙裡,幻想這類事件不會發生在自家孩子身上。」

亞歷山大指出,AI深偽與傳統霸凌不同之處在於:它不是惡意文字或謠言,而是往往會瘋傳且持續浮現的視頻或圖片,形成創傷循環。許多受害者因此陷入憂鬱與焦慮。

「他們會徹底崩潰,因為根本無法證明這不是真實的——畢竟這些偽造內容看起來百分之百逼真」,他說。

亞歷山大說,家長可以先不經意地詢問孩子是否在網上看過搞笑的偽造視頻,藉此開啟話題,接著問孩子:「你想過如果自己出現在這類視頻中會是甚麼感受?」隨後可進一步詢問是否有同學製作過偽造視頻,即使內容看似無害。「根據數據,我敢保證他們會說認識這樣的人」,他說。

倡議組織「The Social Institute」執行長蒂爾尼(Laura Tierney)強調,孩子需要知道,如果遇到深偽內容,他們可以向父母求助而不會惹上麻煩。該機構致力宣傳有責任地使用社媒,並協助學校制定相關政策。

她表示,許多孩子擔心父母會過度反應或沒收手機。她提出「SHIELD」6字應對指南:S代表停止轉發(stop);H代表向可信賴的成人商討(huddle);I代表向發布影像的社交平台通報(inform);E指的是搜集證據(evidence),但切勿下載任何內容;L代表「限制」(limit)社媒使用權限;D則提醒要「引導」(direct)受害者求助。

她坦言:「這個縮寫包含多達6個步驟,正顯示出該問題的複雜性。」