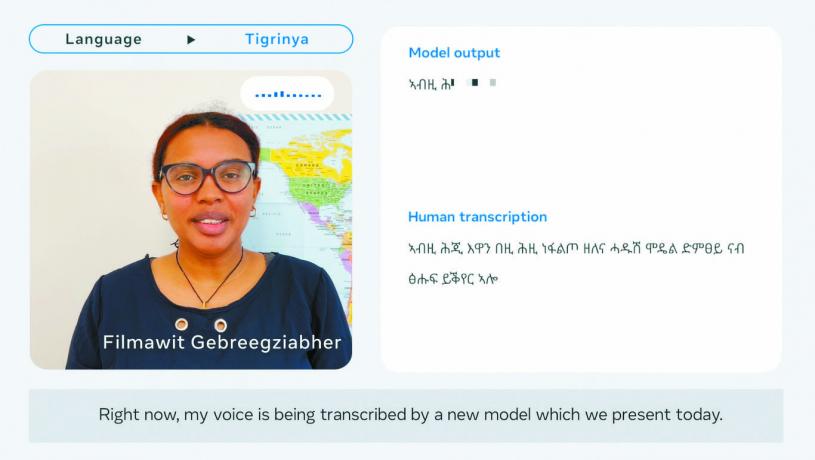

Meta公司創造了一個AI語言模型,並非ChatGPT翻版。大規模多語言語音(MMS)項目可以識別4000多種口語,產生1100多種語音(文本到語音)。Meta將MMS開源以幫助保護語言多樣性,鼓勵研究人員在其基礎上進行研究,「為保護世界上不可思議的語言多樣性做出一點貢獻」。

語音識別和文本轉語音模型通常需要有數千小時的帶有轉錄文本標簽的音頻進行訓練(標簽讓算法正確分類和「理解」數據),但是對於那些沒有在工業化國家廣泛使用的語言,「這種數據根本不存在」,而且其中許多語言在未來幾十年內有消失的危險。

Meta使用了非常規的方法來收集音頻數據:挖掘宗教文本的翻譯音頻紀錄。該公司稱「我們轉向《聖經》等宗教文本,這些文本已被翻譯成許多不同的語言,譯本已被廣泛地用於基於文本的語言翻譯研究,有不同語言的錄音」。結合聖經和其他類似宗教讀物的無標簽錄音,Meta的研究人員將可用語言增加到4000多種。

這種方法乍一看可,像是一個嚴重偏向基督教世界觀的AI模型的配方,但Meta說情況並非如此。「雖然錄音的內容是宗教性的,但分析表明,者並沒有使模型偏向於產生更多的宗教語言」。Meta研究人員說,「我們使用了連接時序分類(CTC)法,與用於語音識別的大型語言模型(LLM)和序列到序列模型相比,它的約束性要大得多」。此外,儘管大多數宗教錄音是由男性演講者朗讀的,此舉也沒有引入男性偏見,在女性和男性的聲音中表現同樣出色。

Meta將MMS與OpenAI的Whisper進行了比較,結果超過預期,「在MMS數據上訓練的模型單詞錯誤率少一半,但覆蓋的語言是後者的11倍。」

Meta提醒說,新模型並不完美,例如,語音到文本的模型可能會誤寫某些單詞或短語,可能導致冒犯性的或不準確的語言。

大科技公司通常支持的全世界的語言不到100種。現在,Meta已經發布了MMS,在其設想的世界中,輔助技術、TTS、甚至VR/AR技術讓每個人都能用母語說話和學習。本報訊