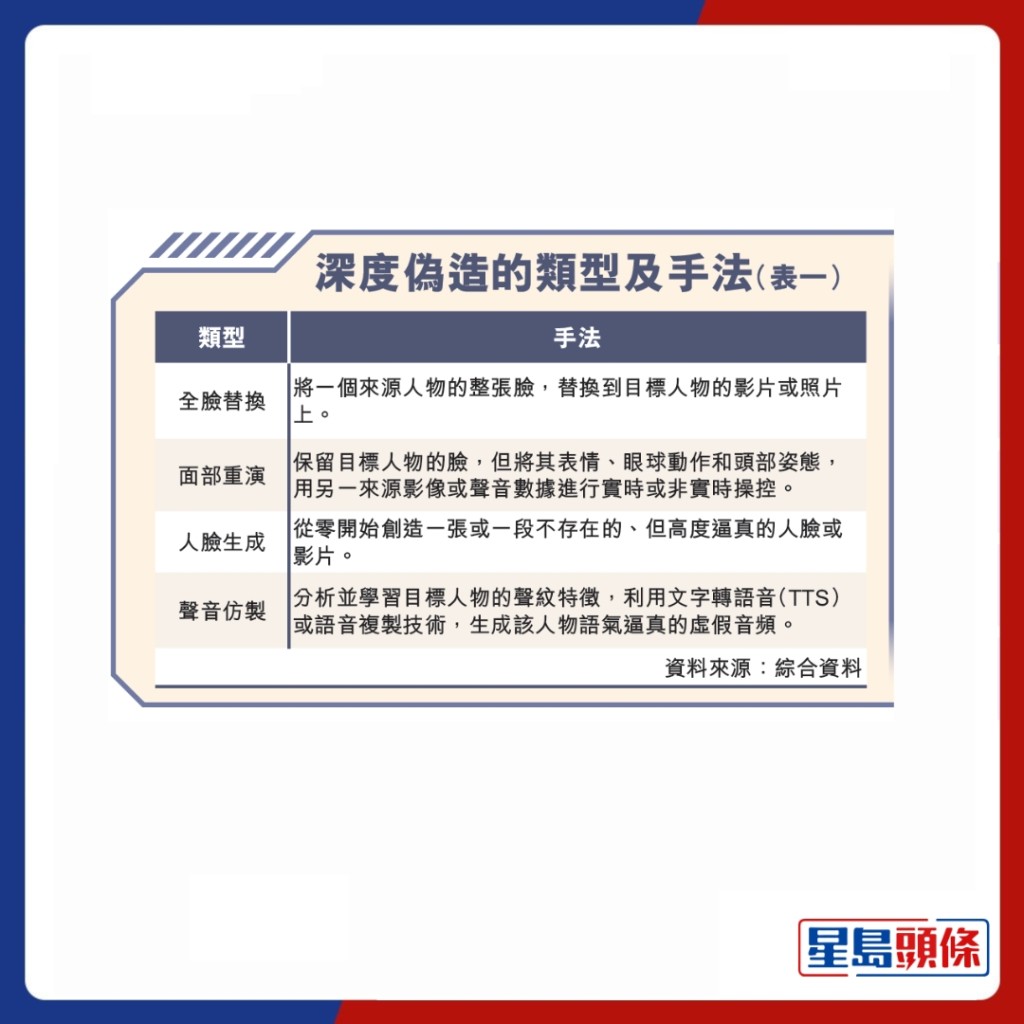

《AI攻防戰系列》之身份詐騙篇

生成式人工智能(AI)的普及令假影像、假聲音、假身份在數碼社會迅速蔓延,隨着深度偽造與合成身份技術被廣泛濫用,犯罪活動更具隱蔽性與破壞力。今年本港深偽個案按年增加147%,有專家指出,犯罪分子已可利用AI複製細微動作,突破傳統活體檢測,難以憑眨眼、轉頭等簡單動作辨識真偽,建議企業應強化AI防禦部署,規管工具使用、提升員工警覺性,配合AI驅動的主動及被動驗證技術,應對日益複雜的深偽詐騙威脅。

深度偽造(deepfake)利用AI技術將他人的臉、聲音或動作精準套入影像素材,製作逼真影片或音訊,用於冒充高層、合作夥伴發動詐騙。早前,一間本港跨國公司職員收到WhatsApp訊息,對方冒充總公司財務總監,疑通過公司公開片段作素材,配合深偽技術篡改說話內容,於視像會議中播放,成功誘騙職員轉款近400萬元。

全球驗證平台Sumsub的數據顯示,全球約有一半企業和用戶在去年曾遭遇身份欺詐,每宗案件平均損失約30萬美元;今年本港深偽欺詐個案按年激增147%。

相關工具使用門檻極低

Sumsub亞太區副總裁Penny Chai表示,隨着AI技術進步,騙徒能通過深度偽造與合成身份(synthetic identity)文件等工具,製造逼真的虛假身份,成功繞過傳統驗證程序,導致帳戶被接管、身份盜竊及未經授權交易等問題,「嚴重損害企業和用戶對數碼生態系統的信賴。」

「有圖有真相」的觀念已不再適用,科技大學工商管理學院署理院長許佳龍說,如今AI能生成豐富內容,收到的訊息有照片、影片、聲音,也不代表是真人。

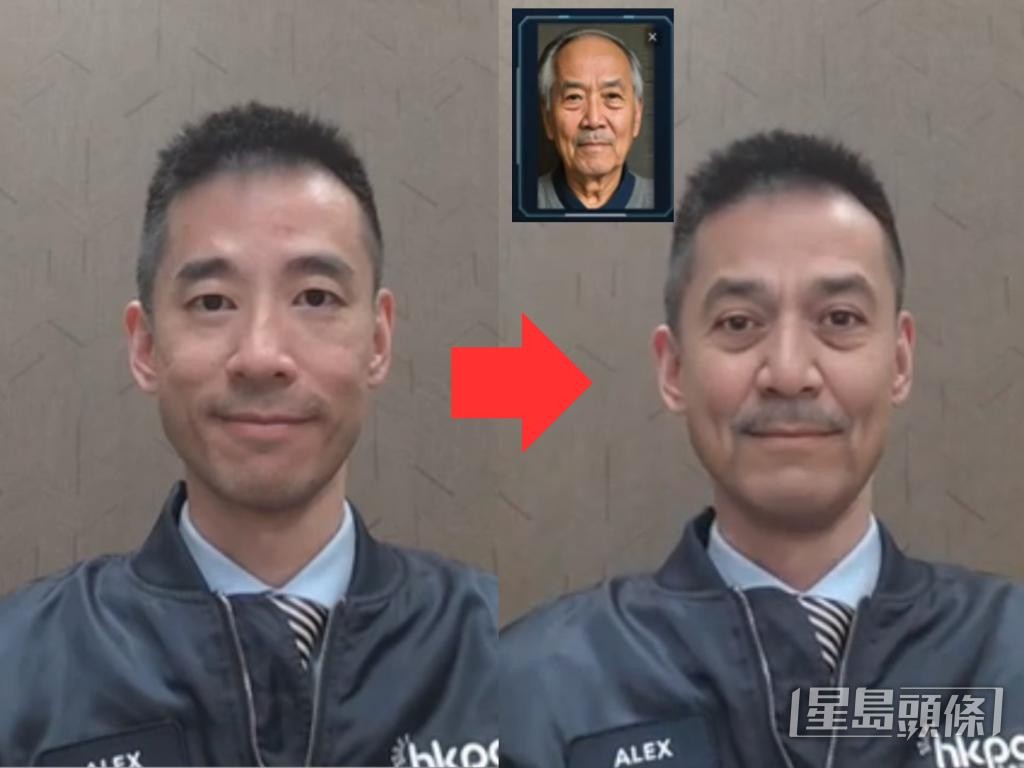

記者網上搜尋發現,深偽工具使用門檻極低,毋須技術知識即可操作。部分音訊生成工具如語音複製、變聲器及文字轉語音,每月僅需約5美元;支援多人視像切換的「換臉」工具起價19.99美元,亦有開源工具可於視像通話中即時換臉。部分平台採免費增值模式,高階服務每月收費達數百至逾千美元,據指價格越高、效能越強,更難被偵測。

本港不少企業採用「活體檢測」作身份驗證,但Penny指,基本的活體檢測方式(如眨眼或轉頭)已不再有效,騙徒現已可利用進階的AI技術複製細微動作,甚至將合成影像直接加入驗證流程,「重送攻擊(透過擷取並重複使用已通過驗證的生物特徵數據再次進行驗證)、即時人臉替換(實時播放影像中疊加另一張臉部的影像)及注入攻擊(植入被篡改的影格或數據)等技術,使簡單的動作指令無法有效防範欺詐行為。」

合成身份犯罪「攻擊鏈」隱蔽

近年更廣泛出現「欺詐即服務」(Fraud-as-a-Service),詐騙者會將相關技術、工具或流程,以服務形式出售或出租給其他犯罪者,Penny表示,罪犯可輕易使用先進的欺詐工具發動精密型攻擊。

騙徒可利用AI將真實資料,如有效的身份證號碼或地址,與虛構姓名、照片或其他身份細節結合,創造全新的虛假身份。該類合成身份「看似真實卻不存在」,能通過基本驗證程序,比完全虛構帳戶更難偵測。

根據《Microsoft數位防禦報告2025》,微軟在過去1年阻止價值40億美元的詐騙,其中不少由AI驅動,並拒絕了4.9萬次虛假合作夥伴註冊嘗試,平均每小時阻擋160萬筆假帳號自動化註冊。報告指出,AI生成的身份證件的全球使用量升195%。以LinkedIn等平台為例,有些假帳號使用AI生成頭像,進行資料蒐集、社會工程詐騙和冒充供應商或業務聯絡人,與其他企業建立聯繫,伺機引發針對企業內部的釣魚或攻擊行動。

科大計算機科學及工程學系副系主任郭嵩提到,合成身份的危害在於完整且隱蔽的「攻擊鏈」,騙徒先創造虛假身份,再執行一些正常行為以建立信任,同時調整身份設定和行為模式避開風險標記,最後累積信用後進行詐騙。他說,這種全鏈路隱蔽性攻擊方式使合成身份極具可信度、難以追溯,「對金融機構和信用體系構成長期且深遠的系統性風險。」

實際上,本地已出現具規模的合成身份犯罪活動,警方上月破獲一個本地詐騙集團,成員利用AI將個人面部特徵融合至報失身份證的頭像,以假冒他人開設網上銀行戶口。結果在23次申請中,有19次成功通過身份驗證。該集團再以這批戶口申請借貸和信用卡,把犯罪得益轉至多個傀儡戶口,一年間處理的黑錢達1.9億元。

結合AI防護工具多重驗證

許佳龍指,攻擊方不斷利用AI偽造訊息,而防禦方也在開發AI協助用戶判斷真偽,例如自動分析訊息構造、識別AI生成痕跡等。他表示,現時已有研究與金融科技公司在開發此類AI防護工具,協助客戶檢測訊息是否可疑,「期待越來越多產品推出市場。」

他提醒,當某一訊息渠道被AI攻破,其可信度會大幅下降,監管層面需重視,鼓勵企業與用戶建立新的驗證方式,如使用「測試問題」來確認對方是否為真實身份持有人。

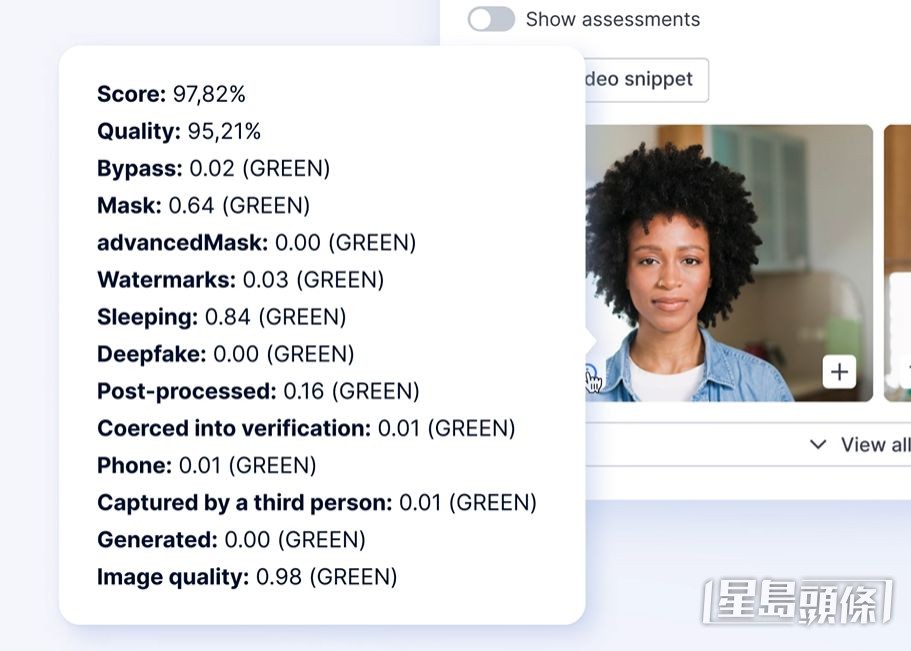

Penny以Sumsub的深偽偵測方案為例,指要應對進階AI技術,可採用AI驅動的活體偵測技術,以主動與被動驗證方式,要求用戶執行特定動作,分析像素與識別影像模式,結合神經網絡運算,掃描用戶臉部、建立3D臉部地圖,並運用能即時學習與適應環境變化的演算法偵測深度偽造痕跡。

企業層面亦需重新檢視內部流程。微軟香港區域科技長許遵發指出,企業應明確規範生成式AI工具的使用權限,強化數據保安設定,持續培訓員工AI素養與網絡安全意識,主動學習提示工程技巧,警惕詐騙威脅如網絡釣魚、AI語音詐騙和深度偽造,同時保持軟件更新及啟用多重驗證,防止身份盜用和資料外洩。

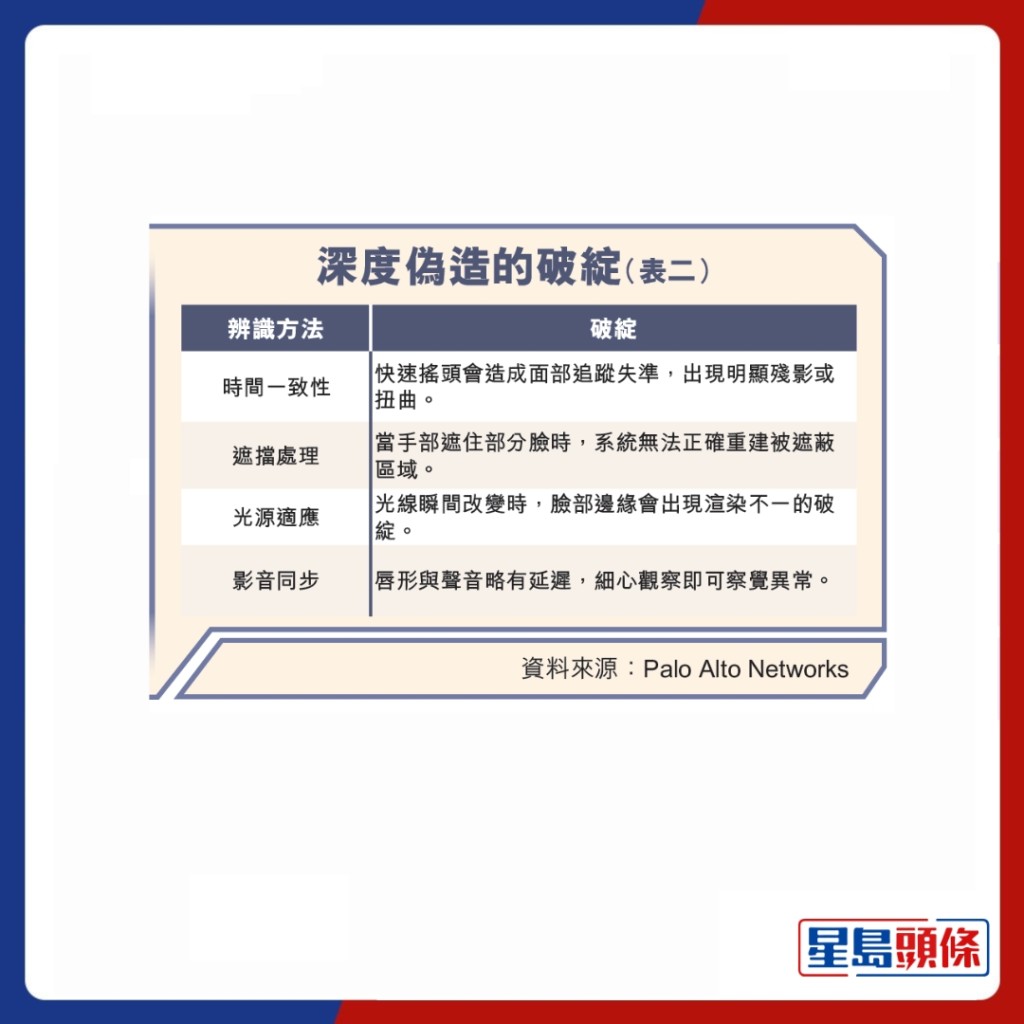

公眾教育亦不可或缺,郭嵩提醒,市民需熟悉AI生成內容的跡象,如表情不自然、語音節奏不連貫、語法和邏輯漏洞等,並對過於完美的內容保持警惕。

員工AI製假收據報銷 皺摺光影幾可亂真

外國有企業員工以人工智能(AI)生成假收據報銷,為會計帶來新挑戰。有專家指,企業的防禦策略須同步演進。

英國《金融時報》報道,多個金融管理平台近月發現大量AI生成收據,當中皺摺、光影與手寫簽名幾可亂真,有平台辨識出價值100萬美元的假收據。報道引述平台指,自去年OpenAI的GPT-4o模型推出後,假收據數量明顯增加,更有公司識破價值過100萬美元的假收據。

Sumsub亞太區副總裁Penny Chai表示,AI讓騙徒輕易製作偽冒文件,企業的防禦策略必須同步演進,如設備情報分析、欺詐網絡偵測系統及善用AI提升準確度與效率,「須定期更新欺詐偵測策略,並安排培訓加強員工意識。」

網安顧問:語音深偽已突破「即時性」限制

有網絡安全顧問公司測試人工智能(AI)即時語音深偽技術,證實相關技術已突破「即時性」限制。

過去的深偽技術多依賴預錄句子或文字轉語音,且對硬件有要求,難進行自然對話及有明顯延遲。惟據NCC Group近期公開的測試報告指,只需一部普通手提電腦、網上的開源AI模型及常見咪高峰,配以不足5分鐘的錄音,便可在數小時內訓練出語音模型,實現延遲低於半秒的即時語音轉換,成本低至一般個人或小型組織可負擔。

研究團隊在多個實戰演練中以該技術取得敏感資訊,誘使受害者更改電子郵件地址、重設密碼或執行內部指令。團隊亦預期,視像深偽在2年內可突破影音同步與人肌肉動態模擬的限制。

記者:潘明卉、林家希

——

《AI攻防戰系列》